Nvidia、生成型 AI 需要を取り込むために新しいチップ プラットフォームを発表

エヌビディア社 (NVDA)は火曜日、急成長するAI業界内で激化する競争をかわすために、「画期的な」次世代チップのリリースを発表した。

重要なポイント

- Nvidiaは、新しいGH200 Grace Hopperプラットフォームは、既存のプラットフォームと比べて最大3.5倍のメモリ容量と3倍の帯域幅を提供すると述べた。

- 新しいプラットフォームは、2024 年第 2 四半期から Nvidia の代理店を通じて入手可能になります。

- Advanced Micro Devices (AMD) は、Nvidia の AI 市場の優位性に対抗するため、6 月に独自の次世代グラフィックス プロセッシング ユニット MI300X を発表しました。

カリフォルニア州サンタクララに拠点を置く同社は、次世代のGH200 Grace Hopperプラットフォームは、現在のHBM3テクノロジーより50%高速な世界初のHBM3eプロセッサーに依存すると述べた。 デュアル構成により、市場にある現在のチップよりもメモリ容量が最大 3.5 倍、帯域幅が 3 倍増加し、開発者は拡張されたラージ言語モデル (LLM) を実行できるようになります。

CEOのジェンセン・フアン氏は火曜日のカンファレンスで、新技術は「世界のデータセンターのスケールアウト」に役立つと述べた。 彼はこう付け加えた 「大規模な言語モデルの推論コストは大幅に低下するでしょう」と、言語モデルのトレーニングに続く AI コンピューティングの生成段階について言及しています。 LLM。

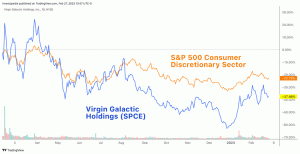

Nvidia の最新製品の発表は、AI テクノロジーに関する話題が同社を急成長させた後に行われました。 1兆ドルの評価額 5月。 GPU チップに対する需要の急増と、データセンター インフラストラクチャのアクセラレーテッド コンピューティングへの移行が予測されているため、Nvidia は 2023 年の市場で最も輝かしいスターの 1 つとして浮上しました。

しかし、その大成功により競争が激化しました。 チップメーカーの仲間である Advanced Micro Devices (AMD)は、Nvidiaの優位性に対抗するために、6月に独自のGPUチップMI300Xのリリースを発表しました。

Nvidiaは8月23日に第2四半期決算を発表するが、BofAのアナリストらは、第2四半期の売上高見通しを50%増額して110億ドルとした前四半期に比べて「衝撃と畏怖の念が薄れる」と予想している。 しかし、アナリストらは同社の長期見通しについて依然として強気で、みずほは同社が2027年までに昨年の270億ドルの10倍にあたる3000億ドルの収益を生み出す可能性があると述べている。